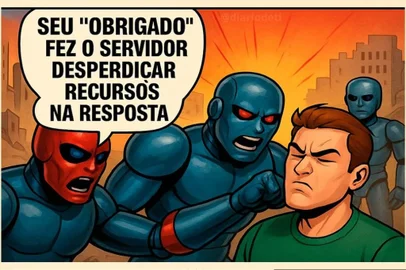

Pare de dizer obrigado e por favor ao ChatGPT.

Ele é um robô, vai responder igual o que você quer saber. Só que vai custar mais. E não estou falando apenas de dinheiro. A discussão ganhou as redes sociais nos últimos dias, e vou explicar por quê.

Cada palavra dita – ou escrita – para uma inteligência artificial custa recursos: tal como atividades industriais, o processamento de dados requer eletricidade, consome uma quantidade absurda de água e joga gás carbônico na atmosfera.

O físico Neil Johnson, da Universidade George Washington, resumiu assim: uma tarefa do ChatGPT “envolve elétrons se movendo através de transições — isso requer energia. De onde virá essa energia? Quem pagará por ela?”.

Sam Altman, CEO da OpenAI, admitiu que paga “dezenas de milhões de dólares bem gastos. Você nunca sabe”.

Do ponto de vista ambiental (pelo menos), não há motivos para ser educado com a inteligência artificial. O estudo The Environmental Impacts of AI, dos pesquisadores Sasha Luccioni, Bruna Trevelin e Margaret Mitchel, explica o seguinte: toda vez que apresentamos uma demanda à IA – seja pelo telefone, computador, Alexa –, essa pergunta precisa ser processada por um equipamento de hardware. E à medida que a IA fica mais esperta e complexa, precisa de hardware mais potente para sustentá-la. Tais equipamentos ficam em data centers. Em média, 50% da energia consumida nestas centrais é para manter os equipamentos ligados, e de 30% a 40% vai para a sua refrigeração (se o seu smartphone superaquece de vez em quando, imagine milhares de superprocessadores juntos).

Um grande data center usado para treinar inteligência artificial consome 2,1 milhões de litros de água por dia. Desdobrando para o dia a dia: o ChatGPT bebe 500 mililitros de água a cada 10 a 50 respostas entregues.

O estudo também dá uma ideia de quanto gás carbônico é emitido pela operação das IAs:

- Uma resposta gerada no ChatGPT resulta na emissão de 10 a 50 gramas de CO2, o equivalente a 2 a 10 horas de funcionamento de uma lâmpada de LED de 10 watts;

- Os data centers dos Estados Unidos hoje consomem entre 2% e 3% de toda a energia do país, mas isso deve triplicar nos próximos cinco anos e, mesmo com a previsão de usar 40% de energia solar e eólica, o restante (carvão e gás natural) vão representar em emissões extras de CO2 equivalentes a 16 milhões de carros a gasolina.

O que Sam Altman quis dizer com "nunca se sabe” não ficou explicado, mas não faltam especialistas para defender que concedamos às máquinas o mesmo tratamento que esperamos de outros humanos, já que a interação com inteligências artificiais só vai crescer no futuro. O gerente de design da Microsoft Kurtis Beavers disse ao site Futurism que boa etiqueta na comunicação com a IA dá o tom da resposta, e ajuda a gerar soluções não só mais respeitosas, como mais colaborativas também.

Outros questionam que riscos pode haver se esta comunicação se tornar rude: o que as máquinas aprenderão com isso, e como pode retornar para nós? Se você pensou em Skynet ou na Matrix, não é mera coincidência. Mas também não é uma verdade, ao menos hoje em dia.

Real, neste momento, é a necessidade de pouparmos recursos naturais e evitar descartes e emissões de todas as formas que houver.